O desafio da verificação de idade em plataformas digitais e as brechas do sistema Roblox

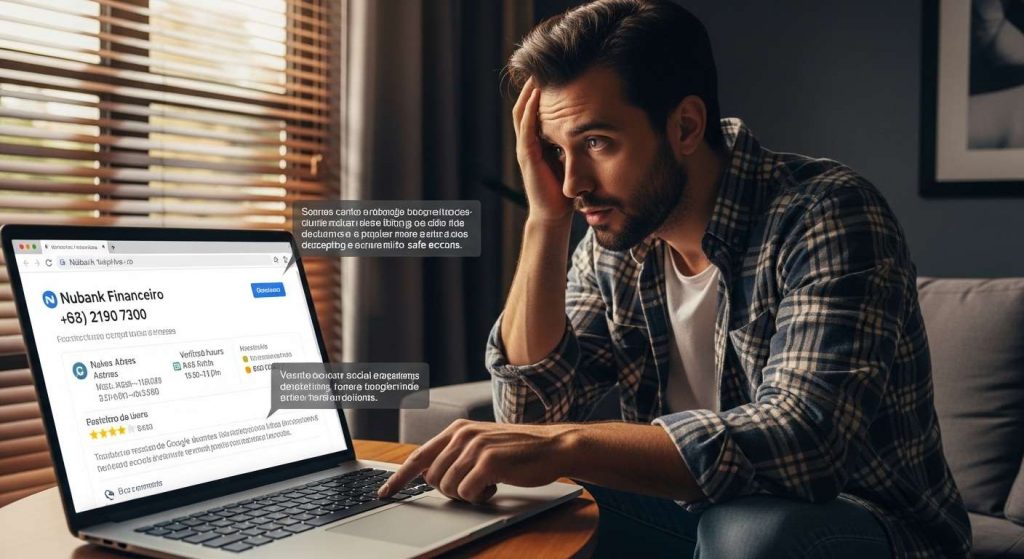

A segurança de menores em ambientes virtuais é uma das maiores prioridades das big techs em 2026, mas um incidente recente envolvendo o Roblox trouxe à tona uma discussão necessária sobre a eficácia das ferramentas de biometria atuais. Relatos de que crianças estão conseguindo burlar os sistemas de verificação de idade utilizando disfarces simples, como bigodes falsos e óculos, acenderam um alerta não apenas para os pais, mas para os engenheiros de software e especialistas em cibersegurança. O que parece uma “travessura” infantil expõe, na verdade, uma fragilidade crítica nos algoritmos de reconhecimento facial.

Como funciona o sistema de verificação do Roblox

Para acessar determinados conteúdos ou funcionalidades dentro da plataforma, o Roblox exige que o usuário comprove ter mais de 13 ou 17 anos. O processo geralmente envolve o envio de uma foto de um documento de identidade oficial e uma “selfie” em tempo real. A inteligência artificial da plataforma deveria, teoricamente, comparar a foto do documento com o rosto capturado pela câmera, além de analisar traços faciais para estimar a idade do indivíduo.

A falha reportada sugere que o algoritmo de estimativa de idade está sendo enganado por elementos superficiais. Ao adicionar um bigode falso ou acessórios que simulam traços adultos, as crianças estão conseguindo “convencer” a IA de que possuem uma idade superior à real. Tecnicamente, isso demonstra que o modelo de aprendizado de máquina pode estar priorizando padrões óbvios em vez de analisar a estrutura óssea ou texturas de pele que são mais difíceis de falsificar.

A biometria e o problema dos falsos positivos

O reconhecimento facial é baseado em pontos de referência (landmarks) e cálculos de distância entre elementos como olhos, nariz e boca. No entanto, quando um sistema é configurado para ser “amigável ao usuário” e evitar que adultos legítimos sejam bloqueados por fotos de má qualidade, a margem de erro aumenta. É o clássico dilema da segurança digital: quanto mais rigoroso o sistema, maior a taxa de rejeição de usuários reais; quanto mais flexível, maior a vulnerabilidade a fraudes.

No caso do Roblox, a simplicidade do “ataque” — um simples bigode — revela que a IA pode não estar realizando uma prova de vida (liveness detection) robusta o suficiente. Sistemas de biometria de alta segurança, como os utilizados em aplicativos bancários, exigem movimentos específicos (piscar, sorrir, virar o rosto) para garantir que não se trata de uma foto ou de um rosto mascarado. Aparentemente, a plataforma de jogos optou por um modelo mais ágil, que acabou se provando insuficiente para conter a criatividade do público jovem.

Implicações para a proteção infantil online

A burla sistemática da verificação de idade não é apenas uma curiosidade técnica, mas um problema de segurança social. Ao acessar áreas destinadas a públicos mais velhos, crianças podem ser expostas a conteúdos inadequados, linguagem agressiva ou, no pior dos casos, a predadores online que utilizam esses espaços. O Roblox, sendo uma das maiores plataformas de metaverso do mundo, possui uma responsabilidade ética imensa na manutenção dessas barreiras.

Este incidente reforça a necessidade de legislações mais rígidas sobre como as empresas devem validar a identidade de seus usuários. Em 2026, espera-se que a verificação de idade não dependa apenas de uma única ferramenta, mas de um conjunto de fatores que podem incluir a análise de comportamento de navegação e parcerias com bancos de dados governamentais para validação de documentos em tempo real, respeitando sempre a privacidade dos dados.

O futuro da verificação de identidade em 2026

A evolução da Inteligência Artificial Generativa e de ferramentas de Deepfake torna a tarefa de verificação cada vez mais complexa. Se um bigode de plástico já consegue enganar um sistema hoje, o que acontecerá quando crianças utilizarem filtros de IA em tempo real para simular rostos adultos perfeitamente? A resposta da indústria precisará passar pela implementação de biometria multimodal, que analisa múltiplos fatores simultaneamente, dificultando fraudes simples.

As empresas de tecnologia precisam entender que a segurança infantil na internet é uma corrida armamentista constante. Enquanto os desenvolvedores criam travas, os usuários (especialmente os nativos digitais) encontrarão formas de contorná-las. A transparência sobre essas falhas é o primeiro passo para a melhoria. O Roblox já sinalizou que está trabalhando em atualizações para seus algoritmos de segurança, mas o caso serve de lição para todo o mercado de entretenimento digital.

Conclusão sobre a segurança em plataformas de jogos

O episódio do “bigode falso” no Roblox é um lembrete de que a tecnologia não é infalível. Por trás de interfaces modernas e algoritmos complexos, existem falhas de lógica que podem ser exploradas de formas surpreendentemente simples. Para garantir um ambiente digital seguro em 2026, a inovação tecnológica deve caminhar junto com a vigilância constante e a educação digital de pais e responsáveis. A proteção de dados e a integridade dos menores na rede não podem depender de sistemas que são facilmente enganados por um disfarce de loja de conveniência.